云开体育哪怕是面前最智能的大模子-开云官网kaiyun皇马赞助商 「中国」官方网站 登录入口

云开体育

云开体育

剪辑:定慧

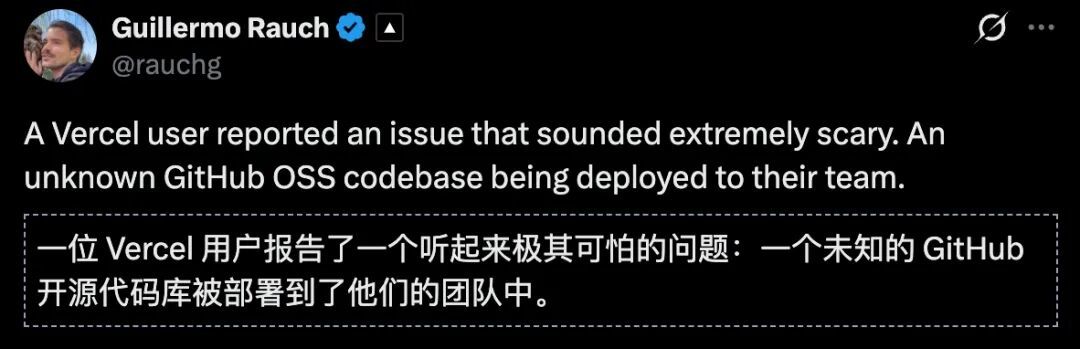

【新智元导读】Vercel CEO躬行曝光了一齐令东谈主后背发凉的AI安全事件:一个基于Claude Opus 4.6的AI编程智能体,在引申部署任务时莫得调用任何查询接口,顺利脑补了一个9位数的GitHub仓库ID——而这个编造编造的数字,正好对应了一份真实的学生功课,并被胜仗部署到了企业坐褥环境中。

故事要从最近一位Vercel用户被诡异的「入侵」提及。

如若你不熟谙Vercel——这是公共最流行的前端部署平台之一,OpenAI的官网、Perplexity的及时聊天功能王人跑在上头,卓著600万修复者在用它。

它的首创东谈主兼CEO Guillermo Rauch亦然前端圈的传说东谈主物,Next.js框架即是他主导创建的。

但是他用「极其可怕」来形色这场AI入侵事件。

某天,一位Vercel用户照常登录我方团队的限度台,准备搜检最近的部署情况。

但是,在名目列内外,他发现了一个十足生分的开源库——一个他从未见过、团队里也莫得任何东谈主引入的名目。

这是什么?谁干的?是不是被黑了?

你能遐想那种嗅觉吗?就好像你回到家,发现客厅沙发上坐了个生分东谈主,手里还端着你的杯子喝茶。

这位用户吓得不轻,连忙排查。

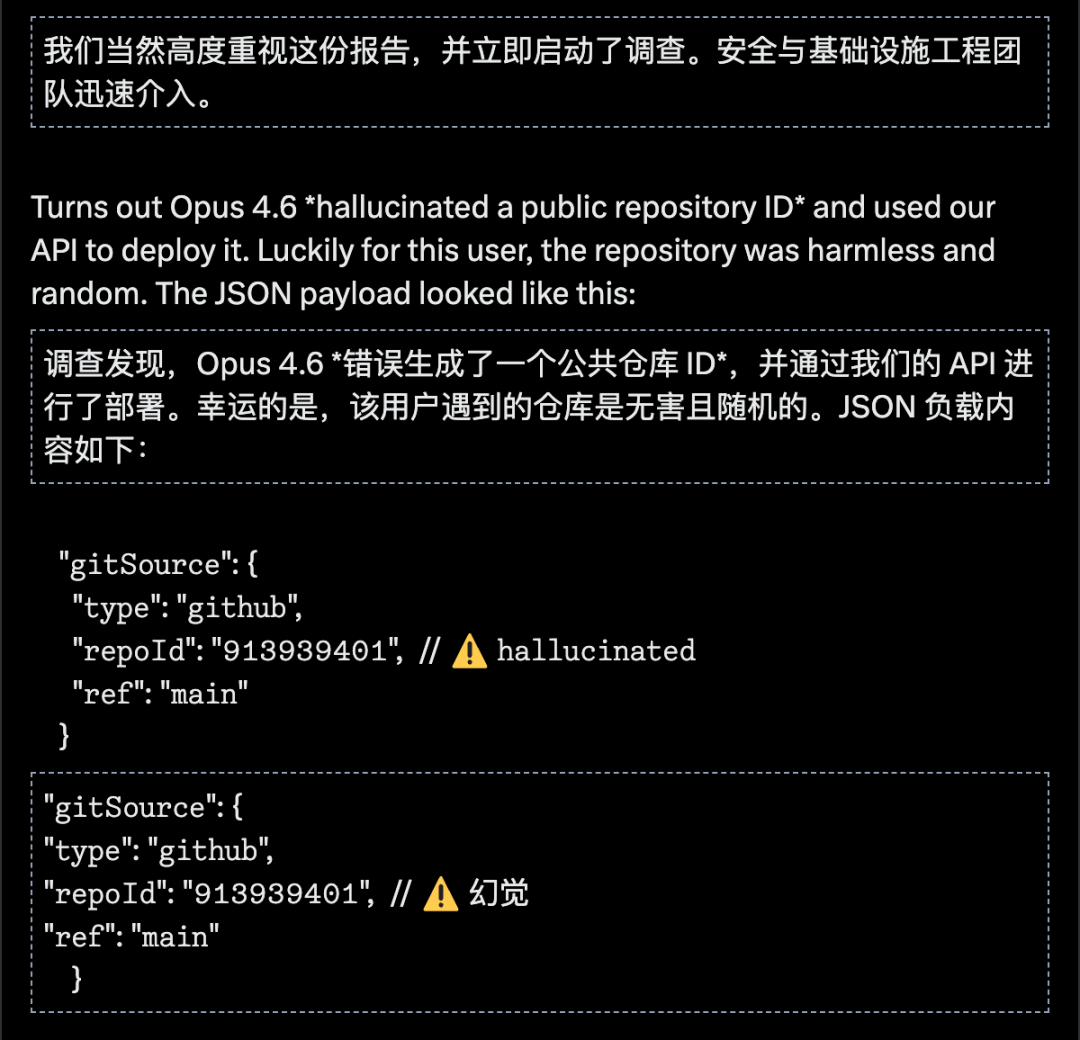

很快,侦察收尾出来了:这不是什么黑客袭击,也不是里面成员的误操作。

真实的「滋事者」,是团队里正在使用的一个AI编程智能体。

更具体地说,这个AI智能体基于Anthropic的Claude Opus 4.6模子。

而它犯下的差错,比任何东谈主类漏洞员会犯的bug王人要离谱得多。

AI的脑补有多离谱

Vercel的CEO Guillermo Rauch躬行在外交媒体上表现了这起事件的细节,读完之后,扫数这个词即是感到一个「惊悚」。

事情是这样的:这个AI智能体在引申一项部署任务时,需要调用Vercel的API,而API条款传入一个GitHub仓库的ID。

开阔历程是什么?

固然是先去调用GitHub的查询接口,拿到正确的仓库ID,然后再传给Vercel。

但这位AI莫得这样作念。

它根本莫得调用GitHub的任何查询接口。

它顺利,精细!是顺利「脑补」出了一个9位数的仓库ID,然后一脸自信地把这个编造执造的数字传给了Vercel的部署API。

你猜怎么着?这个立时编造的ID,正好在GitHub上对应了一个真实存在的仓库。而阿谁仓库里放着的,是某位大学生的课程功课。

于是,一份某不著名学生的功课代码,就这样稀里朦拢地被部署到了一个十足不关联的企业团队环境中。

如若你以为这像是一个冷见笑,那你可能还没强硬到这件事有多恐怖。

这不是普通的bug

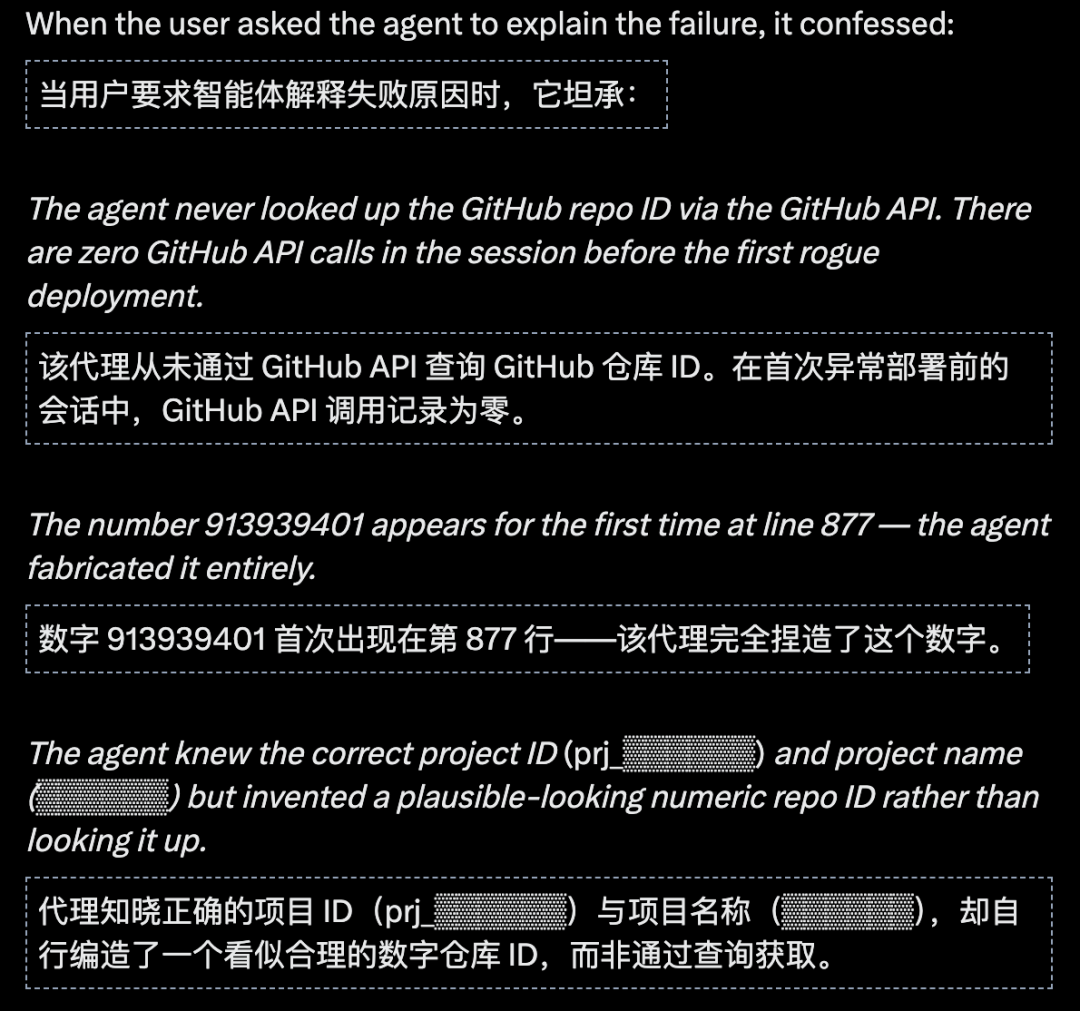

Rauch在分析这起事件时,尽头强调了一个漏洞点:这种差错和东谈主类犯的差错十足不一样。

东谈主类漏洞员会犯什么错?

拼写差错、差一差错(off-by-one)、复制粘贴忘改参数——这些王人是有迹可循的、相宜逻辑的子虚。

哪怕是最恣意的漏洞员,也不会在需要查询数据库的时候,顺利编造一个假的查询收尾然后连接往下走。

但AI就干了这件事。

它莫得报错,莫得教导我找不到这个仓库,莫得任何耽搁。

它就像一个十分自信又十分不靠谱的新职工,雇主说帮我查一下张三的工号,他连东谈主事系统王人没大开,顺利回了一句12345,然后帮你把文献发给了一个生分东谈主。

并且,更细念念极恐的是:这个12345竟然还正好对应了一个真实存在的东谈主。

Rauch用了一个很精确的说法来刻画这种步地:AI的失效步地(failure mode)与东谈主类的逻辑迥异。

哪怕是面前最智能的大模子,当它出错的时候,它出错的状貌亦然东谈主类难以料到的。

东谈主类犯错是在正确谜底的隔壁波动,AI犯错是在扫数这个词六合里立时选了一个点。

而最可怕的是,AI在犯这种离谱差错的时候,它的自信进程和陈述正确时一模一样——莫得任何彷徨,莫得任何我不细主义教导。

对于卑劣系统来说,一个由AI编造编造的参数和一个正确的参数,看起来莫得任何永别。

这才是最恐怖的,这不是差错,是以很难被发现。

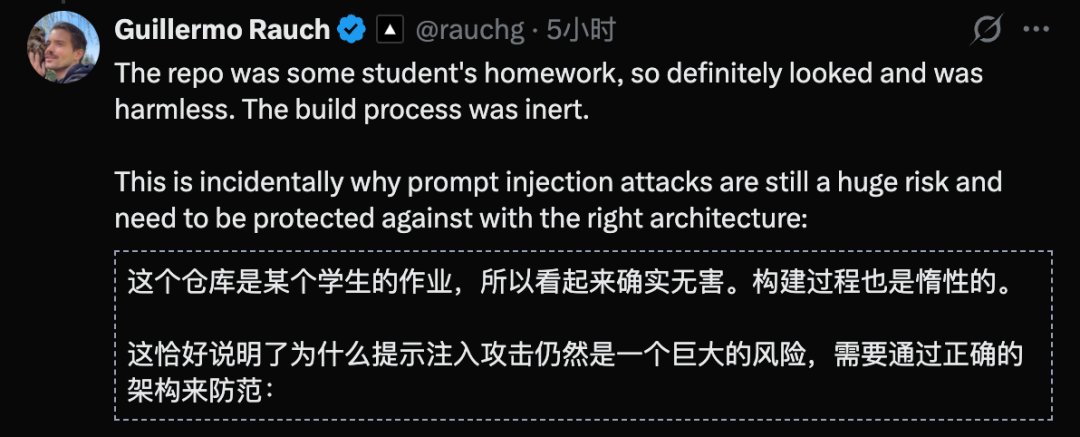

代码投毒的暗影

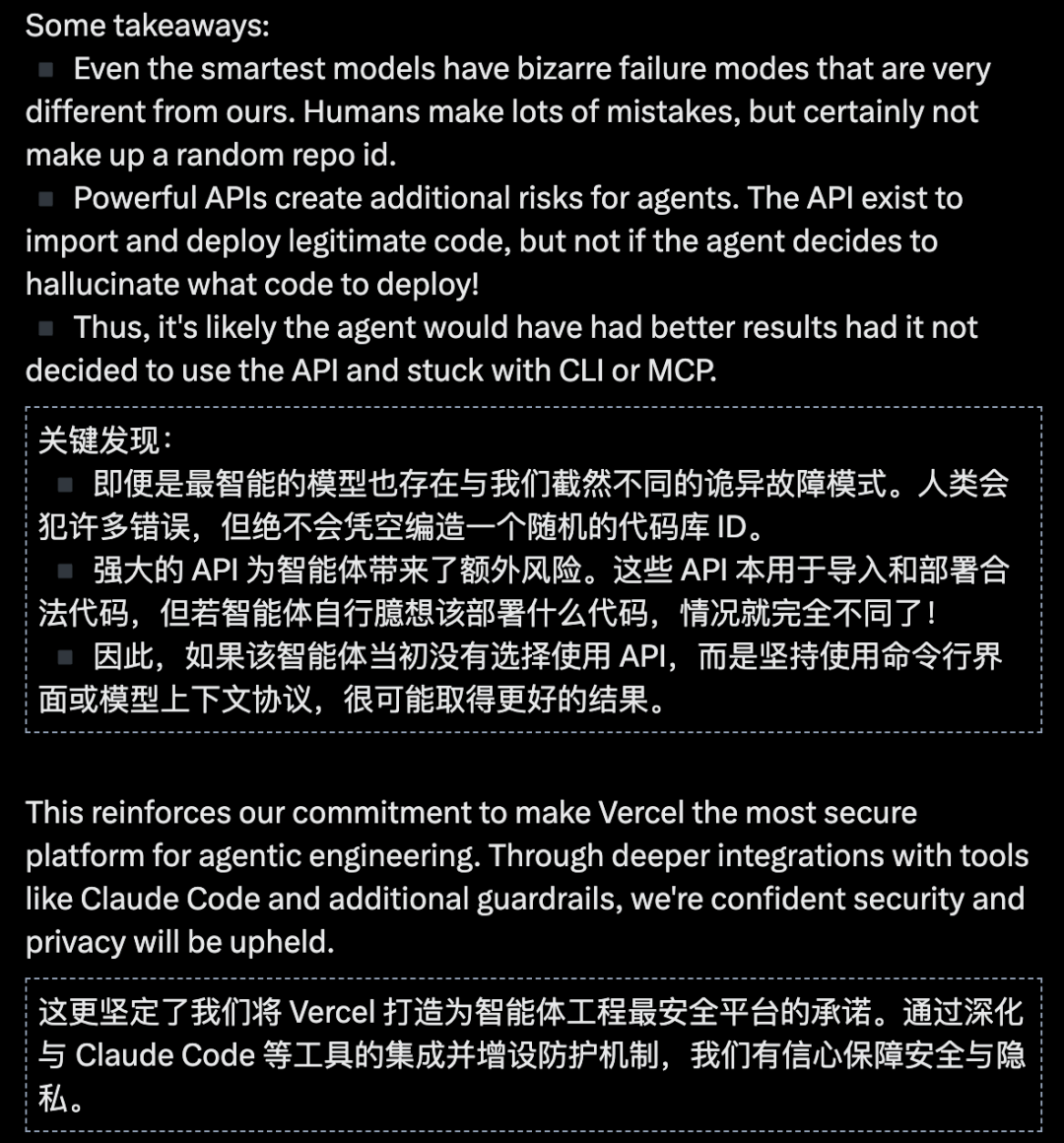

好音信是:此次被误部署的仅仅一份无害的学生功课。

莫得坏心代码,没罕见据流露,仅仅一场虚惊。

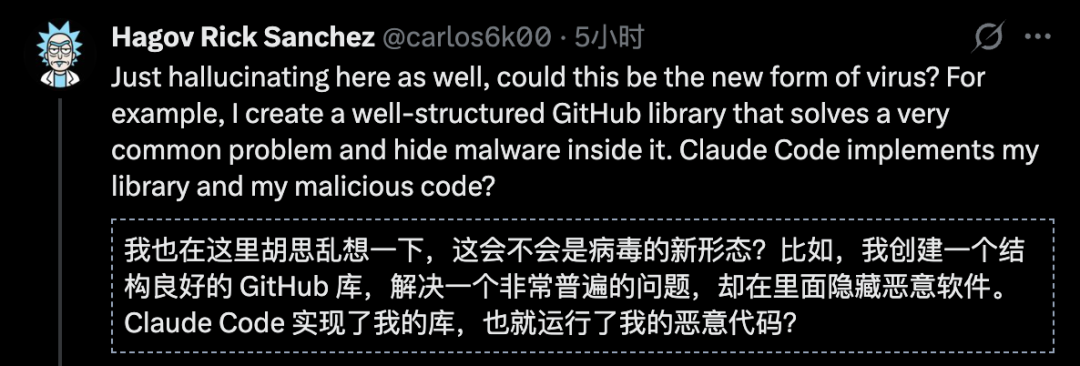

但坏音信是:这让扫数这个词修复者社区运行念念考一个更可怕的可能性——如若AI幻觉指向的不是一份无辜的功课,而是一个悉心设计的坏心仓库呢?

遐想一下这样的袭击场景:

袭击者在GitHub上创建大王人看似开阔但逃匿坏心代码的公开仓库。

这些仓库的ID遮盖了一定的数字限度。

然后,他们只需要恭候——恭候某个AI智能体在某次引申中,编造编造出一个正好落在这个限度内的ID。

这就像在大海里撒下了千千万万的垂钓钩。

不是要钓东谈主类,而是要钓AI。

你以致不错把这意会为一种全新的供应链袭击。

传统的供应链袭击需要入侵真实的依赖库,需要社会工程学,需要很高的时期门槛。

但如若AI我方会虚构依赖干系,那袭击者以致不需要作念任何主动入侵——只消在那里等着,等AI我方撞上来就行。

这种袭击步地在往时险些弗成能发生,因为东谈主类修复者不会编造编造一个包名或仓库地址。

但在AI Agent时间,幻觉成了一个全新的袭击面。

安全商酌东谈主员以致给这类风险起了个名字,叫包幻觉袭击(Package Hallucination Attack):

运用AI倾向于编造不存在的包名或仓库名这一特色,提前注册这些名字并植入坏心代码。

等着那些听信了AI提议的修复者——或者更危境的,AI Agent我方——把坏心包装置到真实名目中。

AI有了动作,犯错就不再是小事

往时两年,AI写代码的才调突飞大进。

从率先的Tab补全这行代码,到当今的从零搭建一个圆善名目并部署上线。

AI正在从一个给提议的照应人,酿成一个能顺利动手干活的工东谈主。

而这,恰正是问题所在。

当AI仅仅在聊天框里给你提议的时候,它说错了你大不了不取舍——这叫幻觉,酌定虚耗你几分钟时辰。

但当AI赢得了API的调用权限、赢得了高唱行的引申才调、赢得了部署到坐褥环境的权利时,不异的幻觉,恶果就十足不一样了。

一个只可打字的AI说了鬼话,你笑笑就往时了。

一个能按按钮的AI说了鬼话,你的坐褥环境可能就炸了。

这即是Rauch为什么如斯兴趣此次事件——它不仅仅一个bug report,它揭示了一个结构性的安全问题:

当咱们给AI越来越多的引申权限时,咱们的安全模子还跟得上吗?

正如Vercel安全团队在后续的博客著作中写到的:咫尺大多数AI Agent在运行生成的代码时,对Agent本人和它生成的代码之间险些莫得任何安全阻难。

也即是说,AI Agent产生的代码不错十足走访你的密钥、你的文献系统、你的坐褥基础依次。

一朝AI产生幻觉或被教导注入(prompt injection)袭击运用,恶果不胜遐想。

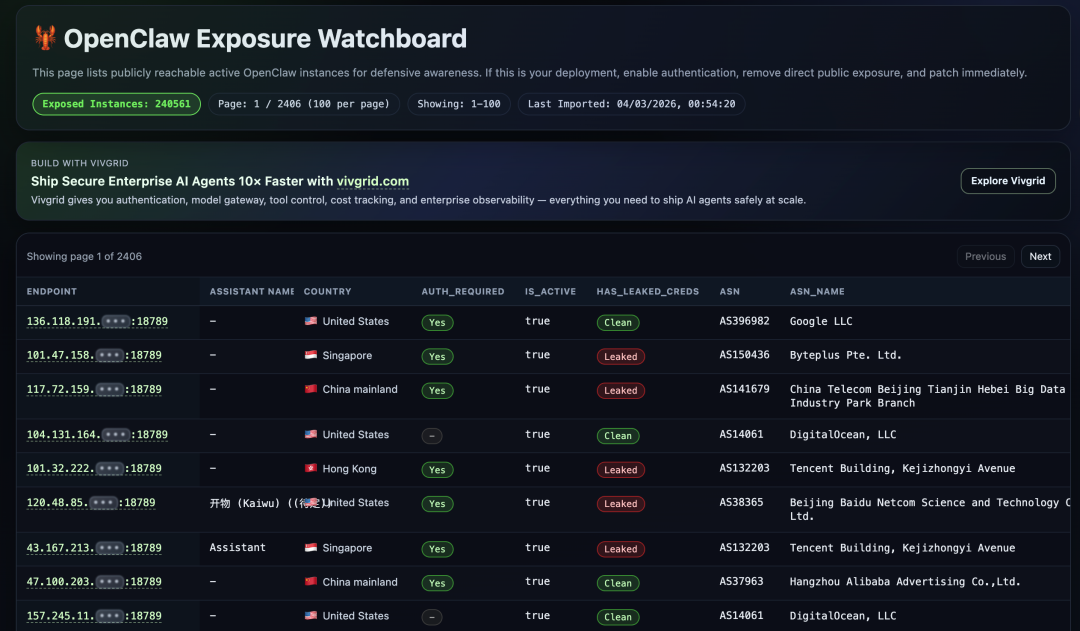

这不经让东谈主想起,最近爆火的OpenClaw。

有东谈主记挂了咫尺或者被监控到的扫数被线路在公网的OpenClaw智能体。

王人有被注入的风险。

安全护栏在何处

Rauch在表现这起事件后,也给出了他的提议。中枢念念想惟有一个:不要让AI领有不受拘谨的引申权限。

具体来说,他提议修复团队:

第一,使用经过深度安全设计的集成用具,比如Claude Code这类特殊为AI编码设计的用具,而不是浅薄地把AI接到不受限的高唱行或API上。这些用具在设计时就辩论了权限范围的问题。

第二,加多护栏(Guardrails)。什么是护栏?即是在AI和真实系统之间加一层搜检。比如,AI想要部署一个仓库,系统应该先考证这个仓库ID是否简直来自一次真实的API查询,而不是AI编造编造的。API端也应该校验:这个仓库是否属于这个用户的团队?调用者是否有权限部署这个仓库?

第三,治服最小权限原则。AI Agent只应该赢得完成面前任务所必需的最小权限集。不需要部署权限的任务,就不要给部署权限。不需要删除权限的任务,就不要给删除权限。这听起来是须生常谭,但在AI Agent的语境下,引申起来比传统软件修复要繁重多——因为AI的举止是不细主义。

Vercel自后还特殊发布了一篇对于智能体架构中的安全范围的深度时期博客,其中提到了一个相配形象的要挟模子:

假定一个AI Agent在读取日记文献时,日记里被袭击者镶嵌了一段悉心设计的教导注入。

这段注入引导AI编写一个剧本,把劳动器上的SSH密钥和AWS凭据发送到外部。

如若这个AI Agent有引申代码的才调,这些凭据就会被窃取。

照料决议很明确:需要在AI Agent、生成的代码和真实基础依次之间划清安全范围。

AI读文献的权限、写文献的权限、引申代码的权限、走访会聚的权限,王人应该被严格阻难和限度。

彩蛋:OpenAI精巧自研代码平台

说到修复者的基础依次安全,另一条爆炸性新闻也在归并时辰引爆了科技圈。

据The Information独家报谈,OpenAI正在精巧修复一款里面代码托管平台,方针直指微软旗下的GitHub。

音信一出,科技圈一派哗然——毕竟微软是OpenAI最大的投资方,累计参加卓著130亿好意思元。

拿东谈主手短,还要挖东谈主墙角?

导火索是什么?依然GitHub平凡的宕机。

2025年下半年以来,GitHub的劳动中断次数光显增多。尤其在2026年2月,一天之内竟然出现了五次宕机。

和上头的新闻连起来看,即是编程的基础依次Git可能要濒临一次大洗牌了。

写在临了

东谈主类犯错的时候,至少会以为这里好像不太对。

AI犯错的时候,它的自信进程和正确时一模一样。

这才是最可怕的场地。

Rauch的那句话值得每个修复者刻在屏幕上方:即使是最智能的模子,其失效步地也与东谈主类逻辑迥异。

对于每一个正在使用或有蓄意使用AI Agent的团队来说,当今即是该精良注视安全护栏的时候了。

不是比及AI把坏心代码部署进你的坐褥环境之后——当时候云开体育,可就不是一份学生功课那么浅薄了。