体育游戏app平台面临日益增长的AI估计需求-开云官网kaiyun皇马赞助商 「中国」官方网站 登录入口

近日,特斯联针对大谈话模子(LLM)在多层云边辘聚积的部署挑战,以及传统调理圭臬的不及,建议了一种两阶段的多层多节点LLM调理算法。该参议着力由特斯联首席科学家、香港科技大学(广州)信息关节物联网学域教育,杨旸博士偏激课题组发布,当今已被通讯边界泰斗国外会议INFOCOM (CCF-A) 收录。本质已矣标明,该惩处决议的浑沌量较传统调理圭臬晋升9.1%-26.3%,好像在多层辘聚积达成LLM的高效部署,并权贵晋升系统性能。

原文概要:

大谈话模子(LLM)因其在解析和反映请示方面的高等才智而受到越来越多的眷注。尽管在多层云边架构中获得了平庸部署,但其性能受到辘集容量的严重规矩,怎么调理高效的数据流以达成性能最大化带来了广泛的挑战。

面临日益增长的AI估计需求,以及LLM在资源受限环境(如物联网和旯旮辘集)中的部署挑战,实时灵验的任务拆分和调理变得尤为环节。这有助于充分开释LLM的后劲,并确保在多层辘聚积高效的资源哄骗。有关词,多层辘集的复杂性和LLM的估计密集性也给任务调理带来了广泛挑战。

针对该挑战,杨旸博士偏激课题组建议了一种两阶段的多层多节点LLM调理算法,用于协同AI估计。该算法通过两阶段的调理框架,优化了多层云边辘聚积的LLM推理。最初,层间LLM自动解耦和分割阶段遴荐整数线性蓄意来灵验地分拨模子大小和估计需求。随后,层内LLM任务调理算法哄骗图神经辘集(GNN)评估资源哄骗率和辘集要求,从而细则每个层内的最好调理节点。本质已矣标明,该惩处决议的浑沌量比传统调理圭臬晋升了9.1%-26.3%。依托此调理算法,该参议好像在多层辘聚积达成LLM的高效部署,并权贵晋升系统性能。

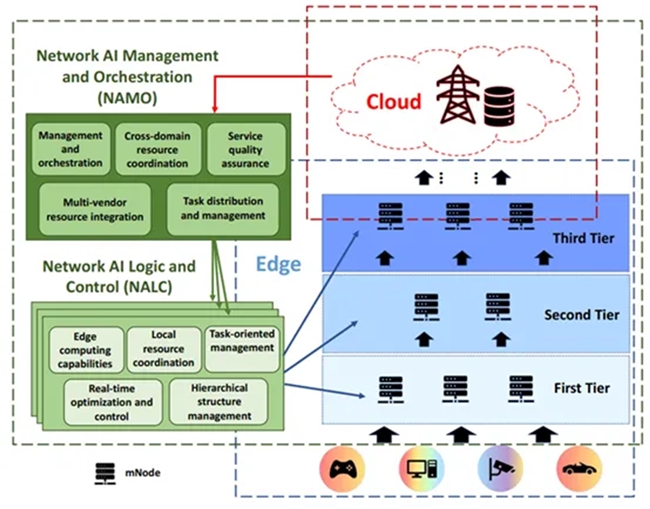

用于优化东谈主工智能(AI)和大谈话模子(LLM)部署的详细多层辘集框架,该框架旨在通过散播式估计来自尊当代AI应用的需求,尤其是由LLM运行的应用。

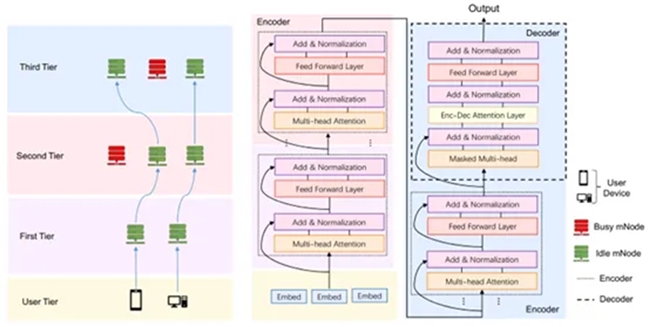

基于Transformer的大谈话模子(LLM)在多层估计环境中的散播式部署架构,旨在通过并行处理优化旯旮估计中的着力和性能。中枢念念想是将LLM模子分割并在不同辘集节点上并行处理,以缩小蔓延和晋升估计着力。

跟着大谈话模子(LLM)限制的握住扩大,单节点估计已无法自尊大部分LLM的需求,散播式估计成为势必趋势。该参议建议的多层级多节点调理框架为高效哄骗散播式资源提供了表面基础和期间支撑,并通过动态资源管束和智能调理计谋,灵验惩处了资源哄骗率低、通讯支出大的问题,为更大限制、更复杂的AI模子部署和更低时延的配合式AI估计奠定了基础。

论文标题:Multi-Tier Multi-Node Scheduling of LLM for Collaborative AI Computing体育游戏app平台。